Semua orang mendengar tentang kemajuan baru dalam kecerdasan buatan, dan terutama pembelajaran mesin. Anda juga telah mendengar ramalan utopian atau apokaliptik tentang apa yang dimaksudkan oleh kemajuan tersebut. Mereka telah diambil untuk mengandaikan sama ada keabadian atau akhir dunia, dan banyak telah ditulis tentang kedua-dua kemungkinan itu. Tetapi AI yang paling canggih masih jauh dari dapat menyelesaikan masalah yang dicapai oleh empat tahun manusia dengan mudah. Walaupun nama yang mengagumkan, kecerdasan buatan sebahagian besarnya terdiri daripada teknik untuk mengesan corak statistik dalam set data yang besar. Terdapat banyak lagi pembelajaran manusia.

Bagaimanakah kita boleh tahu banyak tentang dunia di sekeliling kita? Kita belajar jumlah yang sangat besar walaupun kita masih kanak-kanak kecil; kanak-kanak berumur empat tahun sudah tahu mengenai tumbuhan dan haiwan dan mesin; keinginan, kepercayaan, dan emosi; bahkan dinosaur dan angkasa lepas.

Sains telah memperluaskan pengetahuan kita tentang dunia kepada yang tidak dapat dibayangkan besar dan sangat kecil, ke tepi alam semesta dan permulaan masa. Dan kita menggunakan pengetahuan itu untuk membuat klasifikasi dan ramalan baru, membayangkan kemungkinan baru, dan membuat perkara baru berlaku di dunia. Tetapi semua yang sampai ke mana-mana kita dari dunia adalah aliran foton yang memukul retina dan gangguan udara di telinga kami. Bagaimanakah kita belajar banyak tentang dunia apabila bukti yang kita ada begitu terhad? Dan bagaimana kita melakukan semua ini dengan beberapa kilo kelabu goo yang duduk di belakang mata kita?

Jawapan terbaik sejauh ini ialah otak kita melakukan pengiraan mengenai data konkrit, tertentu, yang tidak kemas yang tiba di deria kita, dan perhitungan itu menghasilkan gambaran yang tepat di dunia. Perwakilan kelihatan berstruktur, abstrak, dan hirarkis; mereka termasuk persepsi objek tiga dimensi, tatabahasa yang mendasari bahasa, dan kemampuan mental seperti "teori fikiran, " yang membolehkan kita memahami apa yang difikirkan oleh orang lain. Perwakilan tersebut membolehkan kami membuat pelbagai ramalan baru dan membayangkan banyak kemungkinan baru dalam cara manusia yang kreatif.

Pembelajaran semacam ini bukan satu-satunya jenis kecerdasan, tetapi ia adalah sesuatu yang sangat penting untuk manusia. Dan ini jenis kecerdasan yang khusus untuk kanak-kanak kecil. Walaupun kanak-kanak sangat buruk dalam perancangan dan membuat keputusan, mereka adalah pelajar terbaik di alam semesta. Kebanyakan proses mengubah data ke dalam teori berlaku sebelum kita berumur lima tahun.

Sejak Aristotle dan Plato, terdapat dua cara asas untuk menangani masalah bagaimana kita tahu apa yang kita tahu, dan mereka masih merupakan pendekatan utama dalam pembelajaran mesin. Aristotle mendekati masalah dari bawah ke bawah: Mula dengan deria-aliran foton dan getaran udara (atau piksel atau sampel bunyi dari imej digital atau rakaman) -dan lihat jika anda boleh mengeluarkan corak dari mereka. Pendekatan ini diteruskan oleh ahli persatuan klasik seperti ahli falsafah David Hume dan JS Mill dan kemudiannya oleh ahli psikologi tingkah laku, seperti Pavlov dan BF Skinner. Pada pandangan ini, struktur abstrak dan hierarki representasi adalah sesuatu ilusi, atau sekurang-kurangnya epiphenomenon. Semua kerja boleh dilakukan dengan persatuan dan pengesanan corak-terutamanya jika terdapat data yang mencukupi.

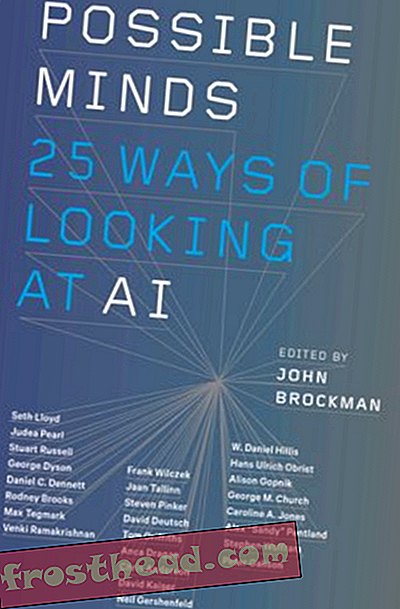

Kemungkinan Pikiran: 25 Cara Memandang AI

Lumens dunia ilmu pengetahuan John Brockman menyusun dua puluh lima minda saintifik yang paling penting, orang-orang yang telah memikirkan kecerdasan buatan lapangan untuk kebanyakan kerjaya mereka, untuk peperiksaan meja bulat yang sukar ditandingi mengenai minda, pemikiran, kecerdasan dan apa yang dimaksudkan dengan menjadi manusia.

BeliDari masa ke masa, terdapat hubungan antara pendekatan bawah ke atas misteri pembelajaran dan alternatif Plato, satu ke bawah. Mungkin kita mendapat pengetahuan abstrak dari data konkrit kerana kita sudah tahu banyak, dan terutama kerana kita sudah mempunyai pelbagai konsep abstrak asas, terima kasih kepada evolusi. Seperti saintis, kita boleh menggunakan konsep-konsep ini untuk merumuskan hipotesis mengenai dunia. Kemudian, daripada cuba mengekstrak corak dari data mentah, kita boleh membuat ramalan tentang apa yang data harus kelihatan seperti jika hipotesis itu betul. Bersama Plato, ahli falsafah dan psikologi "rasionalis" seperti Descartes dan Noam Chomsky mengambil pendekatan ini.

Berikut adalah contoh harian yang menggambarkan perbezaan antara kedua-dua kaedah: menyelesaikan wabak spam. Data terdiri daripada senarai mesej yang panjang dan tersembunyi dalam peti masuk anda. Kenyataannya adalah bahawa sesetengah mesej ini adalah asli dan ada yang spam. Bagaimanakah anda boleh menggunakan data untuk mendiskriminasikannya?

Pertimbangkan teknik bottom-up terlebih dahulu. Anda perhatikan bahawa mesej spam cenderung mempunyai ciri-ciri tertentu: senarai panjang pengadu, asal-usul di Nigeria, rujukan kepada hadiah juta dolar, atau Viagra. Masalahnya ialah mesej yang sangat berguna mungkin mempunyai ciri-ciri ini juga. Sekiranya anda melihat contoh e-mel spam dan nonspam yang mencukupi, anda mungkin melihat bukan sahaja e-mel spam yang cenderung mempunyai ciri-ciri itu tetapi ciri-ciri cenderung untuk bersama-sama dengan cara tertentu (Nigeria ditambah satu juta dolar spell trouble). Malah, mungkin terdapat beberapa korelasi peringkat tinggi yang mendiskriminasi mesej spam daripada yang berguna- corak salah ejaan dan alamat IP tertentu. Jika anda mengesan corak tersebut, anda boleh menapis spam.

Teknik mesin pembelajaran bawah-bawah hanya melakukan ini. Murid mendapat jutaan contoh, masing-masing dengan beberapa set ciri dan masing-masing dilabel sebagai spam (atau beberapa kategori lain) atau tidak. Komputer boleh mengekstrak corak ciri yang membezakan keduanya, walaupun ia agak halus.

Bagaimana dengan pendekatan atas ke bawah? Saya mendapat e-mel daripada editor Jurnal Biologi Klinikal . Ia merujuk kepada salah satu kertas saya dan mengatakan bahawa mereka ingin menerbitkan artikel saya. Tiada Nigeria, tiada Viagra, tiada jutaan dolar; e-mel tidak mempunyai sebarang ciri spam. Tetapi dengan menggunakan apa yang saya sudah tahu, dan berfikir dengan cara yang abstrak tentang proses yang menghasilkan spam, saya dapat mengetahui bahawa email ini mencurigakan:

1. Saya tahu bahawa spammer cuba mengeluarkan wang dari orang dengan menarik diri kepada tamak manusia.

2. Saya juga tahu bahawa jurnal "akses terbuka" yang sah telah mula menanggung kos mereka dengan mengenakan pengarang bukannya pelanggan, dan saya tidak mengamalkan apa-apa seperti biologi klinikal.

Letakkan semua itu bersama dan saya boleh menghasilkan hipotesis baru yang baik tentang di mana e-mel itu berasal. Ia direka untuk mengusir ahli akademik ke dalam membayar untuk "menerbitkan" artikel dalam jurnal palsu. E-mel adalah hasil daripada proses yang sama meragukan seperti e-mel spam yang lain, walaupun ia kelihatan tidak seperti mereka. Saya boleh membuat kesimpulan ini dari hanya satu contoh, dan saya boleh terus menguji hipotesis saya, melebihi apa-apa dalam e-mel itu sendiri, dengan pergi ke "editor".

Dalam istilah komputer, saya memulakan dengan "model generatif" yang merangkumi konsep abstrak seperti tamak dan penipuan dan menerangkan proses yang menghasilkan penipuan e-mel. Ini membolehkan saya mengenali spam e-mel Nigeria yang biasa, tetapi ia juga membolehkan saya membayangkan banyak jenis spam yang mungkin. Apabila saya mendapat jurnal e-mel, saya boleh bekerja mundur: "Ini kelihatan seperti jenis mel yang akan keluar dari proses penjanaan spam."

Keseronokan baru tentang AI datang kerana penyelidik AI baru-baru ini telah menghasilkan versi yang kuat dan berkesan dalam kedua-dua kaedah pembelajaran ini. Tetapi tidak ada yang baru tentang kaedah itu sendiri.

Pembelajaran Deep-Bottom

Pada tahun 1980-an, saintis komputer mencipta cara bijak untuk mendapatkan komputer untuk mengesan corak data: koneksi, atau rangkaian saraf, seni bina (bahagian "saraf" adalah, dan masih, metafora). Pendekatan itu jatuh ke dalam malapet pada tahun 1990-an tetapi baru-baru ini telah dihidupkan semula dengan kaedah "pembelajaran yang mendalam" seperti DeepMind Google.

Sebagai contoh, anda boleh memberi program pembelajaran mendalam tentang sekumpulan gambar Internet yang dilabel "kucing, " yang lain dilabelkan sebagai "rumah, " dan sebagainya. Program ini dapat mengesan corak membezakan kedua-dua set imej dan menggunakan maklumat itu untuk melabel imej baharu dengan betul. Beberapa jenis pembelajaran mesin, yang dipanggil pembelajaran tanpa pengawasan, dapat mengesan corak dalam data tanpa label sama sekali; mereka hanya mencari kumpulan ciri-ciri-ciri saintis yang dikenali sebagai analisis faktor. Dalam mesin pembelajaran mendalam, proses ini diulangi pada tahap yang berbeza. Sesetengah program juga dapat menemui ciri-ciri yang berkaitan dari data mentah piksel atau bunyi; komputer mungkin bermula dengan mengesan corak dalam imej mentah yang sesuai dengan tepi dan garisan dan kemudian mencari corak dalam corak yang sesuai dengan wajah, dan sebagainya.

Satu lagi teknik bottom-up dengan sejarah panjang adalah pembelajaran tetulang. Pada tahun 1950-an, BF Skinner, membina karya John Watson, merpati yang terkenal yang telah diprogramkan untuk melakukan tindakan yang jelas - bahkan membimbing peluru berpandu dilancarkan udara ke sasaran mereka (gema yang mengganggu AI baru-baru ini) dengan memberi mereka satu jadual hadiah dan hukuman tertentu . Idea penting ialah tindakan yang diberi ganjaran akan diulang dan mereka yang dihukum tidak akan, sehingga tingkah laku yang diinginkan dicapai. Malah pada hari Skinner, proses mudah ini, berulang kali berulang, boleh menyebabkan perilaku yang kompleks. Komputer direka untuk melakukan operasi mudah berulang-ulang pada skala yang membina imaginasi manusia, dan sistem pengiraan dapat mempelajari kemahiran yang sangat kompleks dengan cara ini.

Sebagai contoh, penyelidik di DeepMind Google menggunakan gabungan pembelajaran mendalam dan pembelajaran penguatkuasaan untuk mengajar komputer untuk memainkan permainan video Atari. Komputer tidak tahu apa-apa tentang bagaimana permainan berfungsi. Ia bermula dengan bertindak secara rawak dan mendapat maklumat hanya tentang apa yang skrin kelihatan seperti pada setiap saat dan sejauh mana ia mencetak gol. Pembelajaran yang mendalam membantu menafsirkan ciri-ciri pada skrin, dan pembelajaran tetulang memberi ganjaran kepada sistem untuk skor yang lebih tinggi. Komputernya sangat bagus bermain beberapa permainan, tetapi ia juga membombardir sepenuhnya pada orang lain yang sama seperti mudah bagi manusia untuk menguasai.

Gabungan pembelajaran dan pembelajaran penguatkuasaan yang mendalam telah membolehkan kejayaan AlphaZero DeepMind, sebuah program yang mampu mengalahkan pemain manusia di kedua-dua catur dan Go, dilengkapi dengan pengetahuan asas tentang peraturan permainan dan beberapa kemampuan perancangan. AlphaZero mempunyai ciri menarik lain: Ia berfungsi dengan bermain ratusan juta permainan melawan dirinya sendiri. Seperti yang dilakukannya, ia menimbulkan kesilapan yang mengakibatkan kerugian, dan ia mengulangi dan menghuraikan strategi yang membawa kepada kemenangan. Sistem sedemikian, dan yang lain melibatkan teknik yang dikenali sebagai rangkaian adversarial generatif, menjana data serta memerhati data.

Apabila anda mempunyai kuasa pengiraan untuk menggunakan teknik tersebut kepada set data yang sangat besar atau berjuta-juta mesej e-mel, imej Instagram, atau rakaman suara, anda boleh menyelesaikan masalah yang kelihatannya sangat sukar sebelum ini. Itulah sumber banyak kegembiraan dalam sains komputer. Tetapi perlu diingati bahawa masalah seperti mengiktiraf bahawa imej adalah kucing atau perkataan yang diucapkan adalah Siri-adalah remeh untuk anak kecil. Salah satu penemuan sains komputer yang paling menarik adalah masalah yang mudah untuk kita (seperti mengenal pasti kucing) yang sukar untuk komputer-lebih sukar daripada bermain catur atau Go. Komputer memerlukan berjuta-juta contoh untuk mengkategorikan objek yang boleh kita kategorikan dengan hanya beberapa. Sistem bottom-up ini boleh umumkan kepada contoh-contoh baru; mereka boleh melabelkan imej baru sebagai kucing dengan tepat secara tepat. Tetapi mereka berbuat demikian dengan cara yang agak berbeza daripada bagaimana manusia menyamaratakan. Sesetengah imej hampir sama dengan imej kucing tidak akan dikenal pasti oleh kami sebagai kucing sama sekali. Lain-lain yang kelihatan seperti blur rawak akan.

Model Bayesian Top-Down

Pendekatan top-down memainkan peranan besar pada awal AI, dan pada tahun 2000 ia juga mengalami kebangkitan semula, dalam bentuk probabilistik, atau Bayesian, model generatif.

Percubaan awal untuk menggunakan pendekatan ini menghadapi dua jenis masalah. Pertama, kebanyakan corak keterangan mungkin pada dasarnya dijelaskan oleh banyak hipotesis yang berbeza: Ada kemungkinan bahawa mesej e-mel jurnal saya adalah tulen, ia tidak mungkin kelihatan. Kedua, di manakah konsep-konsep yang digunakan model generatif datang dari tempat pertama? Plato dan Chomsky berkata kamu dilahirkan bersama mereka. Tetapi bagaimana kita boleh menerangkan bagaimana kita mempelajari konsep sains terkini? Atau bagaimana walaupun kanak-kanak kecil memahami tentang dinosaur dan kapal roket?

Model Bayesian menggabungkan model generatif dan ujian hipotesis dengan teori kebarangkalian, dan mereka menangani kedua-dua masalah ini. Model Bayesian membolehkan anda mengira betapa kemungkinannya hipotesis tertentu adalah benar, memandangkan data. Dan dengan membuat tweak yang kecil tetapi sistematik kepada model yang kita sudah ada, dan menguji mereka terhadap data, kadang-kadang kita boleh membuat konsep dan model baru dari yang lama. Tetapi kelebihan ini diimbangi oleh masalah lain. Teknik Bayesian boleh membantu anda memilih mana daripada dua hipotesis yang lebih cenderung, tetapi hampir selalu terdapat sejumlah besar hipotesis yang mungkin, dan tidak ada sistem yang cekap dapat menganggap mereka semua. Bagaimanakah anda membuat keputusan hipotesis mana yang patut diuji di tempat pertama?

Brenden Lake di NYU dan rakan sekerja telah menggunakan kaedah top-down seperti ini untuk menyelesaikan masalah lain yang mudah bagi orang tetapi amat sukar untuk komputer: mengenali watak-watak tulisan tangan yang tidak dikenali. Lihat watak pada tatal Jepun. Walaupun anda tidak pernah melihatnya sebelum ini, anda mungkin boleh tahu sama ada ia serupa dengan atau berbeza daripada watak pada skrol Jepun yang lain. Anda mungkin boleh menariknya dan juga merancang watak Jepun yang palsu berdasarkan pada yang anda lihat-yang kelihatan agak berbeza dari watak Korea atau Rusia.

Kaedah bottom-up untuk mengenali aksara tulisan tangan adalah untuk memberi ribuan contoh komputer masing-masing dan biarkan ia mengeluarkan ciri-ciri penting. Sebaliknya, Lake et al. memberi program ini satu model umum tentang cara anda menggambar watak: A stroke berjalan sama ada kanan atau kiri; selepas anda selesai, anda memulakan yang lain; dan sebagainya. Apabila program itu melihat watak tertentu, ia dapat menyimpulkan urutan rentetan yang paling mungkin membawa kepada itu-seperti yang saya nyatakan bahawa proses spam menyebabkan e-mel saya yang meragukan. Kemudian ia boleh menilai sama ada watak baru mungkin disebabkan oleh urutan itu atau dari yang lain, dan ia boleh menghasilkan satu set strok yang sama. Program ini bekerja jauh lebih baik daripada program pembelajaran mendalam yang digunakan untuk data yang sama, dan ia mencerminkan prestasi manusia.

Kedua-dua pendekatan pembelajaran mesin ini mempunyai kekuatan dan kelemahan pelengkap. Dalam pendekatan paling bawah, program ini tidak memerlukan pengetahuan yang banyak untuk dimulakan, tetapi ia memerlukan banyak data, dan ia boleh umumkan secara terbatas. Di dalam pendekatan atas ke bawah, program ini dapat belajar dari hanya beberapa contoh dan membuat generalisasi yang lebih luas dan lebih bervariasi, tetapi anda perlu membina lebih banyak ke dalamnya untuk bermula dengan. Sejumlah penyiasat sedang berusaha untuk menggabungkan dua pendekatan tersebut, menggunakan pembelajaran mendalam untuk melaksanakan kesimpulan Bayesian.

Kejayaan AI baru-baru ini sebahagiannya merupakan hasil daripada sambungan idea-idea lama. Tetapi ia lebih berkaitan dengan hakikat bahawa, terima kasih kepada Internet, kami mempunyai lebih banyak data, dan terima kasih kepada Undang-undang Moore, kami mempunyai lebih banyak kuasa pengiraan untuk memohon kepada data tersebut. Selain itu, fakta yang tidak dihargai ialah data yang kami miliki telah disusun dan diproses oleh manusia. Gambar-gambar kucing yang diposting ke Web adalah gambar-gambar kucing kanonik yang telah dipilih oleh manusia sebagai gambar "baik". Terjemahan Google berfungsi kerana ia mengambil kesempatan daripada berjuta-juta penterjemahan manusia dan menyebarkannya kepada sekeping teks baru, daripada benar memahami ayat itu sendiri.

Tetapi perkara yang benar-benar luar biasa tentang anak-anak manusia ialah mereka menggabungkan ciri-ciri terbaik setiap pendekatan dan kemudian pergi melampaui mereka. Sepanjang lima belas tahun yang lalu, ahli pembangunan telah meneroka cara kanak-kanak mempelajari struktur dari data. Kanak-kanak berumur empat tahun boleh belajar dengan mengambil satu atau dua contoh data, sebagai sistem atas ke bawah, dan umumkan kepada konsep yang sangat berbeza. Tetapi mereka juga boleh mempelajari konsep dan model baru dari data itu sendiri, sebagai sistem bottom-up.

Sebagai contoh, di makmal kami, kami memberikan anak-anak kecil sebagai "pengesan blicket" -a mesin baru untuk mengetahui, yang belum pernah mereka lihat sebelumnya. Ia adalah kotak yang menyala dan memainkan muzik apabila anda meletakkan objek tertentu di atasnya tetapi bukan yang lain. Kami memberi anak-anak hanya satu atau dua contoh bagaimana mesin berfungsi, menunjukkan mereka bahawa, katakan, dua blok merah menjadikannya pergi, sementara kombinasi hijau-dan-kuning tidak. Malah kanak-kanak berusia lapan belas bulan segera memikirkan prinsip umum bahawa kedua objek harus sama untuk membuatnya pergi, dan mereka menyebarkan prinsip itu kepada contoh-contoh baru: Sebagai contoh, mereka akan memilih dua objek yang mempunyai bentuk yang sama untuk membuat kerja mesin. Dalam eksperimen lain, kami telah menunjukkan bahawa kanak-kanak juga dapat mengetahui bahawa beberapa harta yang tidak kelihatan tersembunyi membuat mesin itu pergi, atau bahawa mesin berfungsi pada beberapa prinsip logik abstrak.

Anda boleh menunjukkannya dalam pembelajaran seharian kanak-kanak juga. Kanak-kanak kecil dengan cepat belajar teori intuitif abstrak biologi, fizik, dan psikologi dalam banyak cara saintis dewasa lakukan, walaupun dengan data yang agak sedikit.

Kejayaan mesin pembelajaran yang luar biasa dari sistem AI baru-baru ini, kedua-dua bahagian bawah dan atas ke bawah, berlaku dalam ruang hipotesis dan konsep yang sempit dan ditakrifkan-satu set tepat keping permainan dan bergerak, satu set imej yang telah ditetapkan . Sebaliknya, kanak-kanak dan saintis kadang-kadang mengubah konsep mereka dengan cara radikal, melaksanakan peralihan paradigma dan bukannya hanya menaikkan konsep yang mereka miliki.

Kanak-kanak berusia empat tahun dapat mengenali kucing serta-merta dan memahami kata-kata, tetapi mereka juga boleh membuat kesimpulan baru yang kreatif dan mengejutkan yang melampaui pengalaman mereka. Sebagai contoh, cucu saya sendiri menjelaskan bahawa jika seorang dewasa mahu menjadi anak lagi, dia harus cuba tidak makan sayur-sayuran yang sihat, kerana sayur-sayuran yang sihat membuat anak menjadi dewasa. Hipotesis semacam ini, yang munasabah yang tidak dapat dinikmati oleh orang dewasa, adalah ciri-ciri anak muda. Malah, rakan sekerja saya dan saya telah menunjukkan secara sistematik bahawa kanak-kanak prasekolah lebih baik apabila datang dengan hipotesis yang tidak mungkin daripada kanak-kanak yang lebih tua dan dewasa. Kami hampir tidak tahu bagaimana pembelajaran kreatif dan inovasi ini boleh dilakukan.

Walau bagaimanapun, melihat apa yang dilakukan oleh anak-anak, mungkin memberi petunjuk kepada pengatur cara tentang arah pembelajaran komputer. Dua ciri pembelajaran kanak-kanak sangat menarik. Kanak-kanak adalah pelajar aktif; mereka bukan sahaja menyerap data seperti AIs. Sama seperti percubaan saintis, kanak-kanak secara bermotivasi secara intrinsik untuk mengekstrak maklumat dari dunia di sekeliling mereka melalui permainan dan penjelajahan mereka yang tidak berkesudahan. Kajian terbaru menunjukkan bahawa penerokaan ini lebih sistematik daripada yang dilihat dan disesuaikan dengan baik untuk mencari bukti persuasif untuk menyokong pembentukan hipotesis dan pilihan teori. Membina rasa ingin tahu ke dalam mesin dan membolehkan mereka untuk berinteraksi secara aktif dengan dunia mungkin menjadi laluan ke pembelajaran yang lebih realistik dan luas.

Kedua, kanak-kanak, tidak seperti AI yang sedia ada, adalah pelajar sosial dan budaya. Manusia tidak belajar secara berasingan tetapi memanfaatkan kebijaksanaan terkumpul generasi masa lalu. Kajian terbaru menunjukkan bahawa walaupun kanak-kanak prasekolah belajar melalui tiruan dan dengan mendengar kesaksian orang lain. Tetapi mereka tidak semestinya mematuhi guru mereka. Sebaliknya mereka mengambil maklumat dari orang lain dengan cara yang sangat halus dan sensitif, membuat kesimpulan rumit mengenai maklumat yang datang dari mana dan betapa dipercayai dan secara sistematik mengintegrasikan pengalaman mereka sendiri dengan apa yang mereka dengar.

"Kecerdasan Buatan" dan "pembelajaran mesin" menakutkan bunyi. Dan dalam beberapa cara mereka. Sistem-sistem ini sedang digunakan untuk mengawal senjata, contohnya, dan kita benar-benar harus takut mengenainya. Walau bagaimanapun, kebodohan semulajadi boleh menimbulkan malapetaka lebih daripada kecerdasan buatan; kita manusia perlu menjadi lebih bijak daripada kita dahulu untuk mengawal teknologi baru. Tetapi tidak banyak asas untuk sama ada apokaliptik atau visi utopia AI menggantikan manusia. Sehingga kita menyelesaikan paradoks asas pembelajaran, kecerdasan buatan terbaik tidak dapat bersaing dengan manusia biasa berusia empat tahun.

Daripada koleksi yang akan datang MUNGKIN PERINGKAT: 25 Cara Melihat AI, disunting oleh John Brockman. Diterbitkan oleh susunan dengan Penguin Press, seorang ahli Penguin Random House LLC. Hak Cipta © 2019 John Brockman.